ChatGPT Shopping, el eCommerce conversacional potenciado por IA.

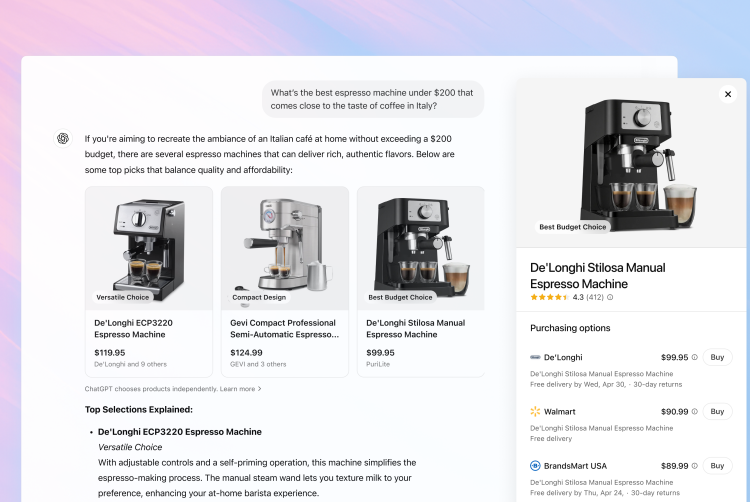

OpenAI ha lanzado recientemente una actualización significativa para su chatbot, integrando la funcionalidad de ChatGPT Shopping. Esta nueva característica permite a los usuarios recibir recomendaciones de productos personalizadas directamente a través de la interfaz conversacional de ChatGPT. Al interactuar con el chatbot, los usuarios pueden obtener sugerencias de productos con imágenes, precios, reseñas y enlaces directos para realizar compras, todo sin necesidad de abandonar la conversación.

Una de las principales ventajas de ChatGPT Shopping es su capacidad para ofrecer resultados orgánicos y no patrocinados (de momento). A diferencia de otras plataformas que priorizan anuncios pagos, esta función se basa en datos estructurados confiables para proporcionar recomendaciones relevantes. Además, la herramienta es accesible para todos los usuarios, incluidos aquellos que no tienen una cuenta en OpenAI, lo que democratiza el acceso a una experiencia de compra más personalizada.

La funcionalidad de ChatGPT Shopping se destaca por su capacidad para comprender consultas en lenguaje natural. Por ejemplo, un usuario puede preguntar: "¿Cuál es la mejor cafetera espresso por menos de $200 que sea adecuada para espacios pequeños?" y recibir recomendaciones precisas que se ajusten a esos criterios. Esta interacción conversacional simplifica el proceso de búsqueda y selección de productos, haciendo que la experiencia de compra sea más intuitiva y eficiente.

Además de las recomendaciones personalizadas, ChatGPT Shopping presenta los productos en un formato visual atractivo, con tarjetas que incluyen imágenes, precios y valoraciones. Esta presentación facilita la comparación de opciones y ayuda a los usuarios a tomar decisiones informadas sin tener que navegar por múltiples sitios web. Al hacer clic en los enlaces proporcionados, los usuarios son redirigidos a los sitios de los comerciantes para completar la compra.

Sin duda, un nuevo paso hacia el cambio en el mundo del eCommerce, al igual que lo está siendo nuestro asistente k__eCommerce que puedes ver en nuestra página.

Más info en el siguiente video:

Técnicas generales de SEO On-Site para optimizar tu web para ChatGPT.

En linea con la tendencia indicada en el anterior articulo, cada vez utilizamos más ChatGPT y menos Google, para hacer nuestras búsquedas de información, por lo que ahora el SEO on-site para ChatGPT se ha convertido en una disciplina crucial para maximizar la visibilidad y el rendimiento de esta poderosa herramienta. A medida que los motores de búsqueda evolucionan, es fundamental adaptar las estrategias para asegurar que ChatGPT alcance su máximo potencial. Este artículo explora las últimas novedades y técnicas para optimizar el SEO on-site de ChatGPT, permitiendo a los usuarios aprovechar al máximo sus capacidades.

Una de las técnicas más importantes es la optimización de palabras clave. Identificar y utilizar las palabras clave correctas en el contenido de ChatGPT es esencial para mejorar su posicionamiento en los resultados de búsqueda. Herramientas como Google Keyword Planner y Ahrefs pueden ser de gran ayuda para encontrar las palabras clave más relevantes y con mayor volumen de búsqueda.

La estructura del contenido también juega un papel fundamental en el SEO on-site. Organizar el contenido de ChatGPT de manera lógica y coherente, utilizando encabezados (H1, H2, H3, etc.) y párrafos cortos, facilita la lectura y la comprensión tanto para los usuarios como para los motores de búsqueda. Esto mejora la experiencia del usuario y, por consiguiente, el posicionamiento.

Otro aspecto crucial es la optimización de metadatos. Los títulos y descripciones meta son elementos clave que influyen en la tasa de clics (CTR) en los resultados de búsqueda. Crear títulos atractivos y descripciones concisas que resuman el contenido de ChatGPT puede aumentar significativamente el tráfico orgánico.

La velocidad de carga del sitio web donde se integra ChatGPT es también un factor importante para el SEO on-site. Optimizar las imágenes, minimizar el código y utilizar un hosting de calidad son algunas de las medidas que se pueden tomar para mejorar la velocidad de carga y, por ende, el posicionamiento en los motores de búsqueda.

Finalmente, la adaptabilidad móvil es imprescindible en el SEO on-site actual. Asegurarse de que ChatGPT se visualice correctamente en dispositivos móviles es fundamental, ya que Google prioriza los sitios web "mobile-friendly" en sus resultados de búsqueda. Un diseño responsive y una buena experiencia de usuario en móviles son clave para el éxito del SEO on-site.

Aqui un video donde puedes entrar en mayor detalle sobre estas tecnicas:

Conferencia RSAC 2025: inmersión completa de la IA en la CiberSeguridad.

La RSA Conference (RSAC) es una de las conferencias más importantes y reconocidas a nivel mundial en la industria de la ciberseguridad. Se celebra anualmente en diferentes ubicaciones, principalmente en Estados Unidos (San Francisco), pero también en Europa, Asia y los Emiratos Árabes Unidos.

La edición de este año de la conferencia RSAC, celebrada a finales de abril y principios de mayo de 2025, se centró en gran medida en el papel cambiante de la Inteligencia Artificial (IA) dentro de la ciberseguridad. Te damos unas pinceladas de los temas mas importantes allí tratados:

- La Revolución de la IA en la Ciberseguridad: Una parte significativa de la conferencia, con alrededor del 40% de las presentaciones, se centró en la IA. Las discusiones fueron más allá de la IA generativa general hacia el auge de los sistemas de "IA agentic", que buscan capacidades más autónomas de detección y respuesta a amenazas. Empresas como Microsoft y Google mostraron sus herramientas de seguridad impulsadas por IA.

- La IA como Arma de Doble Filo: La conferencia reconoció la doble naturaleza de la IA. Si bien ofrece oportunidades para una seguridad mejorada a través de la automatización y el análisis, también presenta riesgos a medida que los ciberdelincuentes adoptan la IA para ataques sofisticados como el phishing y la ingeniería social impulsados por IA.

- IA para la Seguridad y Seguridad para la IA: Este concepto, enfatizado por Cisco, destacó la necesidad de utilizar la IA para reforzar las defensas y al mismo tiempo abordar los nuevos desafíos de seguridad que la propia IA introduce, como las vulnerabilidades en los sistemas de IA y los ataques adversarios.

- Mejora de los Flujos de Trabajo de Seguridad con Agentes de IA: A pesar de la idea futurista de agentes de IA luchando de forma autónoma, el enfoque inmediato en RSAC 2025 estuvo en cómo estos agentes pueden integrarse para mejorar y optimizar los flujos de trabajo de seguridad existentes para los analistas humanos, reduciendo las cargas de trabajo e identificando amenazas de forma proactiva.

- Consideraciones Éticas y Gobernanza de la IA en la Seguridad: A medida que la IA se vuelve más prevalente, las implicaciones éticas y la necesidad de marcos de gobernanza para garantizar un despliegue responsable y confiable también fueron temas importantes de discusión.

- La Importancia de los Principios Fundamentales de la Ciberseguridad: A pesar del entusiasmo en torno a la IA, los aspectos fundamentales de la ciberseguridad como la gestión de identidades siguen siendo cruciales. Los atacantes todavía dependen en gran medida de las credenciales comprometidas, lo que subraya la necesidad de programas sólidos de seguridad de identidad.

- La IA en la Detección y Respuesta a Amenazas: Varias sesiones exploraron cómo la IA y el Aprendizaje Automático (ML) pueden automatizar la detección de vulnerabilidades, ayudar en el análisis de malware, mejorar la inteligencia sobre amenazas y aumentar la eficiencia de los Centros de Operaciones de Seguridad (SOC).

- La Seguridad de los Propios Sistemas de IA: Un área crítica de discusión involucró la comprensión y mitigación de los riesgos asociados con los sistemas de IA, incluidas las técnicas de inyección de prompts, el "jailbreaking" y los ataques de envenenamiento de datos.

- El Papel de la IA en Áreas Específicas: Las discusiones también tocaron el impacto de la IA en áreas como la seguridad en la nube, la seguridad de aplicaciones y la seguridad de los sistemas ciberfísicos y los dispositivos IoT.

En general, RSAC 2025 ofreció una visión de un panorama de ciberseguridad cada vez más moldeado por la IA, con un inmenso potencial para mejorar las defensas y significativos desafíos nuevos que la industria está trabajando activamente para comprender y abordar.

Si quieres saber un poco mas de lo que allí se habló, mírate este par de videos:

Ultimas novedades sobre Agentes IA en Mayo de 2025.

Una noticia significativa proviene de la conferencia RSAC 2025, donde las discusiones giraron en torno al papel de los agentes de IA en la ciberseguridad. Si bien el entusiasmo inicial podría haber sugerido agentes de IA luchando contra atacantes de IA de forma autónoma, el enfoque actual parece estar en cómo estos agentes pueden mejorar y optimizar significativamente los flujos de trabajo de seguridad existentes. Esto indica un enfoque más pragmático e integrado para aprovechar la IA en este dominio crítico.

Curiosamente, se ha destacado que el modelo de IA Qwen3 de Alibaba está acortando significativamente la brecha con las principales empresas tecnológicas estadounidenses. Sus avances en eficiencia de costos y capacidades multilingües lo posicionan como un fuerte competidor para las empresas globales. Si bien no es estrictamente un "agente de IA" en el sentido autónomo, la creciente sofisticación de modelos fundacionales como Qwen3 es crucial para desarrollar agentes de IA más capaces y versátiles en el futuro.

En el ámbito de las aplicaciones, se destacó la capacidad de AMIE (Articulate Medical Intelligence Explorer) de Google para "ver" imágenes médicas. Este avance apunta hacia el desarrollo de agentes de IA especializados capaces de razonamiento e interpretación complejos en dominios específicos como la atención médica, lo que podría ayudar a los profesionales médicos con el diagnóstico y el análisis.

Además, existe un creciente énfasis en los sistemas multiagente, donde múltiples agentes de IA colaboran para lograr objetivos complejos. Marcos como Autogen de Microsoft están facilitando la orquestación de conversaciones e intercambio de tareas entre agentes especializados, pasando del concepto de herramientas de IA aisladas hacia ecosistemas de IA más integrados y dinámicos dentro de las empresas.

Finalmente, también se están destacando las consideraciones éticas y la necesidad de gobernanza y estrategia en la implementación de agentes de IA. A medida que estos agentes se integran más en diversos aspectos del trabajo y la vida, garantizar su despliegue responsable y confiable se está volviendo cada vez más importante tanto para los desarrolladores como para los usuarios finales.

Estos desarrollos recientes sugieren una tendencia hacia aplicaciones más prácticas, capacidades mejoradas a través de modelos fundacionales avanzados y una comprensión cada vez mayor de las complejidades involucradas en la implementación de agentes de IA de manera efectiva y responsable.

Las herramientas y modelos IA en 2025: productividad, código y personalización.

En 2025, los desarrolladores han adoptado una amplia gama de herramientas de inteligencia artificial para mejorar su productividad y eficiencia. Entre las más destacadas se encuentra GitHub Copilot, que ofrece sugerencias de código en tiempo real y ha sido ampliamente adoptado por su integración fluida en entornos de desarrollo. Además, herramientas como Tabnine y Codeium también han ganado popularidad por su capacidad para generar código de manera eficiente y precisa.

Otra herramienta que ha revolucionado el desarrollo de software es Cursor, una plataforma que permite a los desarrolladores escribir código utilizando comandos en lenguaje natural. Esta herramienta ha sido adoptada por empresas como Stripe y Spotify, y ha sido valorada por su capacidad para generar líneas de código de manera rápida y eficiente.

En el ámbito de los modelos de lenguaje, ChatGPT de OpenAI sigue siendo una de las opciones más utilizadas por los desarrolladores. Su capacidad para comprender y generar texto en lenguaje natural lo convierte en una herramienta versátil para diversas aplicaciones, desde la generación de contenido hasta la asistencia en la programación. GPT-4.1 de OpenAI, la última versión de OpenAI, se ha consolidado como el modelo más utilizado por desarrolladores debido a su capacidad avanzada de razonamiento y generación de código. Con mejoras significativas respecto a versiones anteriores, GPT-4.1 ha demostrado una eficacia notable en la resolución de problemas de programación, alcanzando una tasa de éxito del 69.1% en pruebas estándar de la industria, frente al 4.4% en 2023. Además, OpenAI ha lanzado herramientas complementarias como Codex CLI, facilitando aún más la integración de GPT-4.1 en flujos de trabajo de desarrollo.

Además, Claude de Anthropic ha ganado terreno como una alternativa centrada en la seguridad y la ética en la IA. Su enfoque en la alineación de valores y la reducción de sesgos lo hace atractivo para desarrolladores preocupados por la responsabilidad en el uso de la inteligencia artificial. Claude 3.7 Sonnet, desarrollado por Anthropic, se destaca por su enfoque en la seguridad y la ética en la inteligencia artificial. Este modelo ha sido adoptado por desarrolladores que priorizan la responsabilidad en el uso de la IA, ofreciendo capacidades avanzadas de razonamiento y una interfaz conversacional intuitiva. Su diseño centrado en la alineación de valores lo convierte en una opción preferida para aplicaciones sensibles y entornos regulados.

Por otro lado, Gemini 2.5 de Google DeepMind ha sido reconocido por su capacidad de razonamiento avanzado y su integración de múltiples modalidades, incluyendo texto, imagen y audio. Estas características lo posicionan como una herramienta poderosa para desarrolladores que buscan soluciones más complejas y adaptativas. Gemini 2.5 Pro ha demostrado un rendimiento superior en diversos benchmarks, superando a competidores como OpenAI, Anthropic y DeepSeek en tareas relacionadas con la comprensión, las matemáticas, la codificación y las capacidades multimodales. Este rendimiento ha sido reconocido en plataformas como LMArena, donde ha obtenido una ventaja significativa en puntuaciones ELO.

Finalmente, los modelos de código abierto como Llama 3 de Meta han sido ampliamente adoptados por su flexibilidad y capacidad de personalización. Estos modelos permiten a los desarrolladores adaptar las herramientas de IA a sus necesidades específicas, fomentando la innovación y la experimentación en diversos proyectos. Llama 3, la última iteración de los modelos de código abierto de Meta, ha ganado tracción entre los desarrolladores por su flexibilidad y capacidad de personalización. Meta ha lanzado recientemente una API para facilitar la integración de Llama en diversas aplicaciones, permitiendo a los desarrolladores comenzar con una sola línea de código. La estrategia de Meta de ofrecer modelos abiertos y control total a los desarrolladores ha sido bien recibida, fomentando la innovación y la adopción generalizada.

Si quieres profundizar en este estudio, echale un vistazo a este video: